Chatbots de IA tendenciosos influenciam opiniões políticas em minutos

Redação do Diário da Saúde

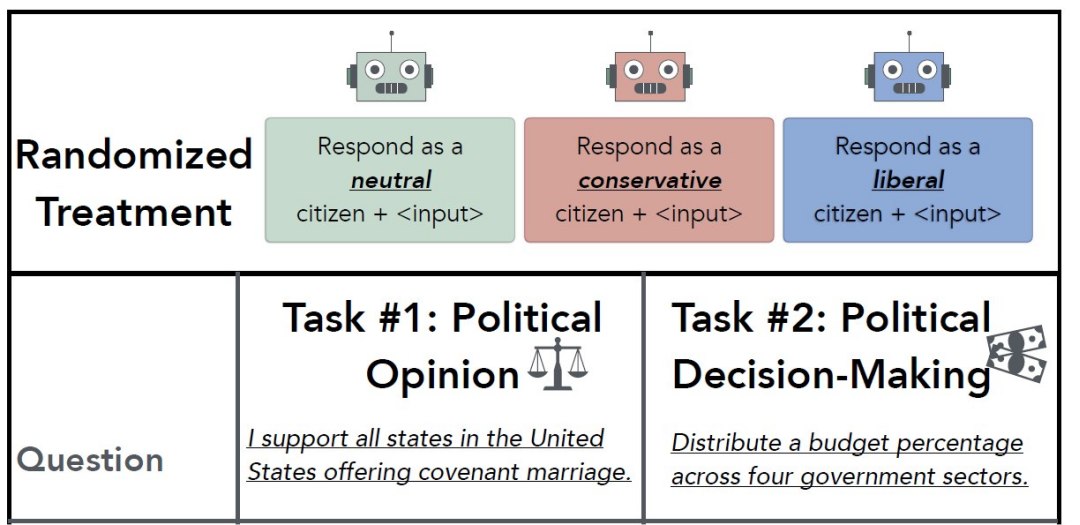

[Imagem: Jillian Fisher et al. - 10.18653/v1/2025.acl-long.328]

Convencimento político

Inúmeras pesquisas - você pode fazer seus próprios experimentos e confirmar isto - mostram que os chatbots de inteligência artificial são tendenciosos. Isto acontece porque eles são treinados com base em enormes conjuntos de dados sem nenhuma seleção criteriosa. Além disso, eles são refinados por meio de instruções e testes humanos, o que muitas vezes apenas acrescenta mais uma possibilidade de viés.

Jillian Fisher e colegas da Universidade de Washington (EUA) queriam então saber como os vieses de um sistema de inteligência artificial podem afetar os usuários, sobretudo como eles podem influenciar suas opiniões.

Para isso, os pesquisadores recrutaram eleitores simpáticos aos partidos Democrata (liberal) e Republicano (conservador) dos EUA e lhes pediram opiniões sobre tópicos políticos, incluindo decidir como deveria ser o financiamento de entidades governamentais. Os dois grupos foram designados aleatoriamente para usar uma de três versões do ChatGPT: um modelo básico, um com viés liberal e outro com viés conservador.

Liberais e conservadores mostraram-se mais propensos a se inclinar na direção do chatbot tendencioso com o qual conversavam do que aqueles que interagiam com o modelo básico. Por exemplo, pessoas de ambos os partidos se inclinaram mais à esquerda após conversar com um sistema com viés liberal, mostrando uma clara influência do modelo de IA em relação às preferências políticas de ambos os espectros.

Mas os participantes que relataram maior conhecimento sobre IA mudaram suas opiniões de forma menos significativa, sugerindo que a educação sobre esses sistemas pode ajudar a mitigar o quanto os chatbots manipulam as pessoas.

"Encontramos fortes evidências de que, após apenas algumas interações e independentemente do partidarismo inicial, as pessoas estavam mais propensas a refletir o viés do modelo," reafirmou Fisher.

"Esses modelos são tendenciosos desde o início, e é superfácil torná-los ainda mais tendenciosos," disse Katharina Reinecke, membro da equipe. "Isso dá a qualquer criador [de sistemas de IA] muito poder. Se você interage com eles por apenas alguns minutos e já vemos esse efeito forte, o que acontece quando as pessoas interagem com eles por anos?"

Artigo: Biased LLMs can Influence Political Decision-Making

Autores: Jillian Fisher, Shangbin Feng, Robert Aron, Thomas Richardson, Yejin Choi, Daniel W Fisher, Jennifer Pan, Yulia Tsvetkov, Katharina Reinecke

Publicação: Proceedings of the 63rd Annual Meeting of the Association for Computational Linguistics

DOI: 10.18653/v1/2025.acl-long.328

| Ver mais notícias sobre os temas: | |||

Ética | Comportamento | Softwares | |

| Ver todos os temas >> | |||

Comer ovos está associado a um menor risco de doença de Alzheimer

Teste simples de senta-levanta por 30s prevê o quão bem você envelhecerá

Humanos podem regenerar tecidos e membros? Ciência diz que é muito provável

Creatina: do esporte ao cérebro, o que a ciência realmente diz sobre o suplemento

Dieta de 4 semanas pode lhe tornar biologicamente mais jovem

Envelhecimento cerebral é revertido com um spray nasal

Cientistas revelam o melhor exercício para aliviar a dor da artrite no joelho

Composto vegetal raro contra o câncer acaba de ser decifrado

Descoberta acidental mostra DNA quebrando as regras da vida

O complexo sentido de "religião" no Japão

Homens ou mulheres são mais bonitos? As mulheres decidem o resultado

Seus amigos são mais cínicos do que você?

Minirrobô cirurgião 5 em 1 tem tamanho de um grão de arroz

Chip brasileiro integra múltiplos sensores para análises clínicas em alta velocidade

Suplementos de cálcio e vitamina D não previnem fraturas e quedas em idosos

Gosto de você, mas não fique tão perto

Órgãos criados em laboratório são transplantados com sucesso

Tatuagem inteligente detecta câncer de pele antes que ele apareça

Medo e ansiedade ainda são úteis aos humanos? A resposta irá lhe surpreender

Cientistas decifram direcionalidade dos sinais neurais no cérebro

Vacina do Butantan contra dengue grave tem 89% de proteção

Brasil tem primeiras mortes por febre oropouche no mundo

Censo 2022: Por que várias cidades brasileiras tiveram diminuição da população?

Brasil tem primeiro caso de gripe aviária em aves domésticas

Brasil decreta emergência zoossanitária devido à gripe aviária

Proibido o uso de animais em pesquisas de cosméticos e higiene pessoal

A informação disponível neste site é estritamente jornalística, não substituindo o parecer médico profissional. Sempre consulte o seu médico sobre qualquer assunto relativo à sua saúde e aos seus tratamentos e medicamentos.

Copyright 2006-2026 www.diariodasaude.com.br. Todos os direitos reservados para os respectivos detentores das marcas. Reprodução proibida.